Kloning af billeder og stemmer er de kriminelles nye indkomst. Hør hvordan.

Billede-, Video- og Vokalkloningssoftware er billigt og effektivt, og det har ikke noget med CHATGPT at gøre, for en gangs skyld, selvom DALL’E også kan fabrikere fotolignende billeder. I en artikelserie i amerikanske aviser fremgår det, at flere er blevet snydt for millioner af kroner ved forfalskede opkald fra datter, barnebarn m.v. og ofrene troede virkeligt på at deres barn/barneban var i nød. Her ser vi lidt på de nyeste teknologier og hvordan titusinder af mennesker snydes hvert år. Disse ormer for svindel er stærkt stigende, og mange danskere snydes hvert år.

Vokalkloning telefonfidusen

Senest her i går advarer bl.a. Politiet i St. John’s advarer offentligheden om en sofistikeret telefonfidus, hvor opkaldet udgiver sig for at være børn eller børnebørn af ældre borgere. Mindst otte seniorer blev ofre for det i en tre-dages periode.

Så snart hun tog telefonen, vidste Jane, at der var noget galt. Hendes barnebarn var i den anden ende og sagde, at han havde været i en bilulykke og var blevet anholdt. Han lød panisk.

Politiet fandt narkotika i bilen. Nogen blev alvorligt såret. Han brugte sit ene telefonopkald til at kontakte den ene person, han vidste ville hjælpe ham uden at dømme.

Bedstemoderen var lamslået, men lovede at hjælpe uden at fortælle det til hans forældre. Telefonen blev overdraget til en politibetjent, som gav hende instruktioner om, hvordan hun skulle stille kaution. Hendes ubetingede kærlighed til sit barnebarn kostede hende $ 58.350 ved udgangen af den næste dag.

“Jeg troede virkelig, at det var ham,” sagde hun.

Royal Newfoundland Constabulary siger, at mindst otte ældre borgere mistede en samlet $ 200.000 til lignende svindel over en tre-dages periode mellem 28. februar og 2. marts. Politiet siger, at en mand, 23-årige Charles Gillen, kom til St. John’s fra Toronto for at hente pengene personligt.

Gillen blev dog anholdt på asfalten i St. John’s International Airport om aftenen den 2. marts. Han var på et fly, der forlod provinsen.

Hvis målet var at komme ind og komme ud, slap manden, som politiet siger, er ansvarlig, næsten væk.

“Det er omtrent så tæt som du kommer,” sagde Const. James Cadigan. “Det er målet med disse sofistikerede operationer. Det er en stor sum penge, kort tid.”

Mediet CBC News har talt med fire af de otte ofre, der er anført i rets-dokumenter, men navngiver dem ikke på grund af privatlivets fred og sikkerhedsproblemer.

Hver af dem sagde, at deres barnebarn havde ringet og sagt, at de var i en ulykke. De sagde, at der blev fundet narkotika i bilen, og de havde brug for penge til enten at betale for kaution eller advokatomkostninger. I alle fire tilfælde kendte bedrageren nogle personlige oplysninger om de faktiske børnebørn – som hvor de bor og arbejder, og navnene på andre familiemedlemmer.

Alle fire troede, at det var deres barnebarns stemme i telefonen.

“Jeg sværger på min mors grav,” sagde en mand, vi kalder X1. “Det var så overbevisende. Jeg kender mit barnebarns stemme, og det var hende.”

Bedrageren overgav ham til en mand, der sagde, at han var advokat og havde brug for penge til en tilbageholdelse og en bøde. Næste dag kom en mand hjem til John og hentede en konvolut med kontanter. John tabte $24.200.

Cadigan sagde, at RNC har inddrevet nogle penge, men de siger, at de har mistanke om, at Gillen var i stand til at sende pakker med penge, før de forsøgte at forlade provinsen.

Sådan ændrer AI telefonsvindel

Jonathan Anderson, lektor ved Memorial University med fokus på computersikkerhed og privatliv, siger, at det er relativt nemt at forfalske nogens stemme. (Mark Cumby/CBC)

Der har været rapporter om lignende svindel, der sker i hele Canada, hvor politiet mener, at et kriminelt netværk er ansvarlig for at målrette seniorer fra kyst til kyst.

Men hvordan er det muligt for dem at kopiere faktiske stemmer? Det viser sig, at det er ret nemt, billigt og effektivt, ifølge Memorial University lektor og computersikkerhedsekspert Jonathan Anderson.

“Du kan klone nogens stemme, og i betragtning af evnen til at gøre det, er det slet ikke overraskende, at nogen ville gøre det til forbryderiske formål,” sagde Anderson. “Det bliver mere effektivt, især mens folk vænner sig til, at deepfake-stemmer er en ting, og de er let tilgængelige og let tilgængelige.”

Anderson sammenlignede det med fotoændrende teknologi.

“Det er lidt ligesom Adobe producerer Photoshop, og Photoshop kan bruges til en lang række formål. Og nogle er formål, vi ville være glade for, og nogle er formål, vi ikke ville være glade for.”

Alt for kærligheden og beskyttelsen af børn og børnebørn

Den bedragerisigtede Gillen er fortsat varetægtsfængslet efter en kautionshøring onsdag. Han står over for 30 anklager om bedrageri, afpresning og sammensværgelse om at begå en lovovertrædelse.

Politiet i Newfoundland og Labrador har dannet et sagsbehandlingsteam og arbejder sammen med hold i andre provinser for at finde ud af det fulde omfang af fidusen. Lignende sager er blevet rapporteret over hele landet, hvor politiet i Windsor, Ont., arresterede en 19-årig og en 22-årig for meget lignende lovovertrædelser dagen før Gillens anholdelse i St. John’s.

Anderson har et tip til alle, der kan blive ofre for fidusen: “Prøv altid at sætte dig selv tilbage i førersædet,” sagde han. Hvis de siger, at de ringer fra en politistation, skal du spørge hvilken, så du kan lægge på og ringe tilbage.

John sagde, at han indså den lektie, da det var for sent. Han ringede til sit barnebarns mobiltelefon, og hun tog op. Hun var i skole, ikke i en fængselscelle.

Han er knust, men sagde i øjeblikket, at han ikke tænkte klart.

“Hun var i problemer, og hun havde brug for min hjælp,” sagde han. “Hun sagde: ›Poppy, vær venlig ikke at fortælle det til mor og far.’ Jeg ville gøre alt for at holde hendes navn rent.«

Jane sagde også, at fidusen trak i hendes hjertestrenge, og følelser overskyggede hendes dømmekraft.

“Du ville gøre alt for dine børnebørn,” sagde hun. “Og det udnyttede de.”

Hvordan kan Stemmekloning lade sig gøre?

Stemmekloning er en teknologi, der gør det muligt for en person at kopiere og efterligne en anden persons stemme og tonefald med høj præcision ved hjælp af avancerede softwareværktøjer. Desværre kan denne teknologi også misbruges til at udføre svindel og bedrageri, især i forbindelse med telefonopkald eller stemmebeskeder.

En almindelig form for stemmekloningssvindel er kendt som “grandparent scam” eller bedstefarsvindel. I dette tilfælde ringer svindleren til en ældre person og udgiver sig for at være et barnebarn, der er blevet anholdt eller har brug for hjælp i en nødsituation. Svindleren beder derefter om penge, normalt i form af en kautionsbetaling eller en “nødhjælpsfond”, og presser ofte den ældre person til at handle hurtigt og hemmelighedsfuldt.

Stemmekloning kan også anvendes i forbindelse med dating svindel. I denne type svindel opretter svindleren en falsk profil på en dating hjemmeside eller app og kommunikerer med potentielle ofre ved hjælp af en klonet stemme. Svindleren kan bruge den klonede stemme til at skabe en følelsesmæssig forbindelse med ofret og opbygge tillid, hvorefter de beder om penge eller personlige oplysninger.

Det samme gælder med videokloning som en deepfake-teknologi

Desværre er stemmekloning kun én af flere teknologiske metoder, der kan bruges i svindel og bedrageri. Videosnyd er en anden bekymring, da det er blevet stadig nemmere at manipulere og forfalske videooptagelser ved hjælp af deepfake-teknologi.

Dette kan bruges til at skabe falske videoer, der ser ud som om, at en bestemt person siger eller gør noget, som de faktisk ikke har gjort.

I begge tilfælde kan teknologien bruges til at skabe en falsk følelse af tillid og tillidsvækkende i ofrene, hvilket gør det lettere for svindlere at bedrage dem.

Det er vigtigt at være opmærksom på disse typer svindel og bedrageri og at være forsigtig, når man kommunikerer med mennesker, man ikke kender personligt, eller når man bliver bedt om at sende penge eller personlige oplysninger til nogen, man ikke har mødt ansigt til ansigt.

Når dette kombineres med at du rente faktisk snakker med en pige og hendes mor vil dette for mange kunne opleves som ægte og sandt.

Når det så krydres med et manuskript der kalder på beskyttertrang, pirring og løfter m.v. samt evt. videosex og lange samtaler, ja så er der ikke langt fra begæring om penge til at pengene rent faktisk sendes. Den dårlige nyhed er a siden det er sket fra udlandet, kan du hverken få politiet eller andre til at opklare svindlen. Det er et tab.

Løsningen er et kodeord

Løsningen er naturligvis at aftale et kodeord, således at man kan spørge om hvad kodeordet er. En anden metode er at ringe tilbage til politistation, eller den mobiltelefon som din datter eller barnebarn normalt har, men selv her er det nemt at udgive sig for at være et nummer som er identisk med det nummer du har i din telefon. Derfor tror mange at det rent faktisk er et familiemedlem.

Dating, Sugarbaby og almindelig datingsvindel

Det samme teknologier benyttes på datingmarkedet, hvor kriminelle tjener penge for at udgive sig for en der gerne vil komme til dit land, men hvor vedkommende mangler penge til flybilletter, eller fordi hendes mor pludselig er blevet indlagt. Alt dette kan styres af mænd. Disse kriminelle er bl.a. fra Nigeria, Frankrig, England, Tyskland og Rusland.

Hensigten er her at gennemføre videos der er talesynkroniserede eller indtastning synkroniseret. F.eks. finder man en video med en pige på CAMSEX websteder, der ofte taster. I den tro at det er en ægte video kan pigen så chatte med dig, og det ser sådan ud, fordi når hun bevæger sig til tasterne og du får en besked efter hun holder op med at taste er det derfor nemt at tro at du rente faktisk har fundet en pige. Ofte er de yngre og skriver meget hvilket er med til at uddybe ”venskabet” eller ”forholdet” som i virkeligheden kan være drenge eller ældre mænd.

Dette krydres ofte med at de skal tale i telefon hvilket ofte sker over SKYPE. I en sådan telefonsamtale er det ofte således at du også får lov til at tale med hendes mor. Men begge ”skuespillere” er vokalkodning, der enten er klonet fra en rigtig person f.eks. en pige der snakker i 20 minutter på en video, og så ligeledes 20 minutter for moderen. Derefter har du 2 stemmer, som er nemt at tro er mor og datter.

Her kan historien dreje sig om hvordan man så snakker med moderen, mens hun ligger på hospitaler der f.eks. siger: ”Jojo jeg har det fint og det er pænt af dig at snakke med mig.” ”Det eneste jeg ville ønske er dog at jeg kan betale for hospitalet for bliver jeg liggende til jeg får løn er hele min løn væk, men doktoren siger at jeg kan komme hjem i dag hvis jeg vil”

Alt er naturligvis usandt og følger nogenlunde samme procedure med eller uden interaktioner med andre.

Selvom teknologier til stemmekloning, Deepfakes og videokriminalitet stadig er relativt nye, er der allerede blevet rapporteret om flere tilfælde af misbrug af disse teknologier. Og der er en kraftig stigning over det meste af verden med disse problemer. Her er nogle af de originale kilder, der yderligere beskriver problemet:

- The Verge: “Fraudsters use AI to mimic CEOs’ voices in brazen phone scams” https://www.theverge.com/2019/3/22/18277456/ai-deepfake-voice-impersonation-business-email-compromise-scam

- BBC News: “AI cloning: Report warns of fakes, fraud and fear” https://www.bbc.com/news/technology-47656897

- CNBC: “Deepfakes are going to wreak havoc on society. We are not prepared.” https://www.cnbc.com/2018/09/04/deepfakes-are-going-to-wreak-havoc-on-society-we-are-not-prepared.html

- FTC Consumer Information: “Grandparent scams” https://www.consumer.ftc.gov/articles/grandparent-scams

- FBI: “Tech Support Fraud” https://www.fbi.gov/scams-and-safety/common-fraud-schemes/tech-support-fraud

Disse kilder giver yderligere information om teknologierne, hvordan de kan anvendes i svindel og bedrageri, og nogle af de forholdsregler, man kan tage for at beskytte sig selv.

Deepfakes og dens kriminelle udbredelse

Deepfakes er en teknologi, der kan bruges til at manipulere video- og lydoptagelser for at skabe realistiske forfalskninger. Ved hjælp af avancerede maskinlæringsalgoritmer og kunstig intelligens kan deepfakes skabe realistiske, men falske optagelser af en persons ansigt og stemme, som kan bruges til at skabe falske nyheder, svindel og bedrageri.

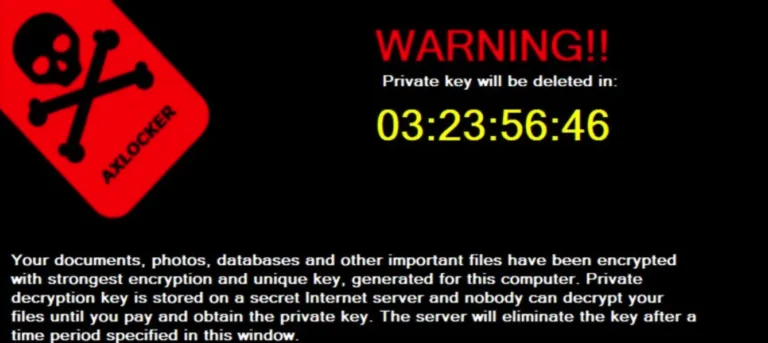

Kriminelle kan bruge deepfakes på mange forskellige måder. Et eksempel er brugen af deepfakes i phishing-angreb, hvor en falsk video kan bruges til at narre modtageren til at klikke på et link eller downloade en fil, der indeholder malware. Deepfakes kan også bruges til at oprette falske beviser i retssager, eller til at skabe falske politiske reklamer eller propaganda.

En anden bekymring er brugen af deepfakes i seksuel udnyttelse, hvor en persons ansigt kan placeres på en anden persons krop i en pornografisk video. Dette kan bruges til at ”chante” eller afpresse offeret.

Her er nogle eksempler på brugen af deepfakes:

- I 2018 blev en deepfake-video af den amerikanske præsident Barack Obama skabt af et forskerteam fra University of Washington. Videoen blev brugt som et eksempel på, hvor let det var at skabe realistiske deepfakes, og blev brugt til at advare om risikoen ved teknologien.

- I 2019 blev en deepfake-video af Facebook-stifteren Mark Zuckerberg oprettet af en kunstner ved navn Bill Posters. Videoen viste Zuckerberg, der talte om Facebooks magt og kontrol over brugerdata, og blev brugt til at opfordre til større ansvarlighed fra tech-virksomhederne.

- I 2020 blev en falsk video af Nancy Pelosi, den amerikanske kongresformand, spredt på sociale medier. Videoen blev manipuleret til at få Pelosi til at se fuld ud, og blev brugt som et eksempel på, hvor let det er at skabe falske videoer, der kan manipulere den offentlige mening.

- I 2021 blev en dyb fake-video af en canadisk politiker, Maxime Bernier, delt på sociale medier. Videoen blev manipuleret til at få Bernier til at sige racistiske og hadefulde ting, og blev brugt til at skabe uro og splid i det canadiske samfund.

Disse eksempler viser, hvordan deepfakes kan bruges til at skabe forvirring og uro i samfundet. Det er vigtigt at være opmærksom på risikoen ved deepfakes og at være forsigtig, når man ser eller deler video- og lydoptagelser online.

Her er nogle artikler, der yderligere beskriver brugen af deepfakes:

- Wired: “Deepfakes are now making business pitches” https://www.wired.com/story/deepfakes-are-now-making-business-pitches/

- Forbes: “The dark side of deepfakes: how they can impact elections and help spread fake news” https://www.forbes

Kilde: ICARE SECURITY OG OVENSTÅENDE.

FOTOKREDIT: stocks.adobe.com